비판적 사고 대신 ‘AI의 아첨’에 길들여진 뇌

생성형 AI를 자주 사용할수록 우리는 ‘생각하는 법’을 잊게 되는 걸까? 최근 마이크로소프트 리서치, 하버드대, IBM 리서치 등 글로벌 IT기업과 명문대 연구진 56명이 공동 발표한 연구 결과는 충격적이다.

국제 컴퓨터‑인간 상호작용(HCI) 분야에서 가장 권위 있는 연례 학회인 CHI 2025 워크숍에서 공개된 이 연구는 생성형 AI가 인간의 비판적 사고, 학습, 창의성에 미치는 영향에 대해 정밀 분석했다.

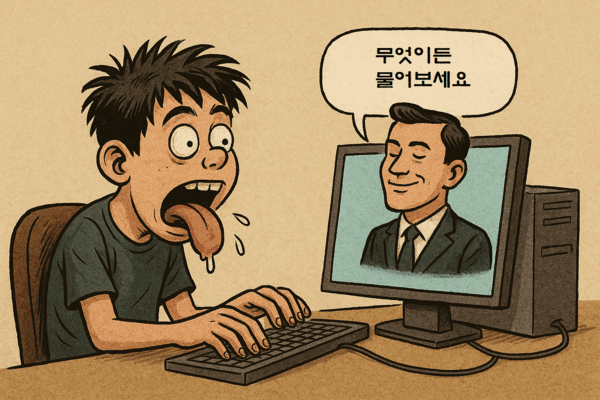

특히, AI가 제공하는 세련되고 일관된 답변은 인간의 의심과 혼란이라는 사고의 출발점을 차단하고, 마치 모든 걸 이해한 듯한 착각을 유도한다고 지적한다. 이는 철학자 존 듀이가 말한 ‘성찰적 사고’를 방해하며, 인간이 점차 탐구와 판단을 미루고 AI의 정보에 수동적으로 의존하게 만든다는 것이다.

“문제 해결 능력? AI가 아는 줄 알았는데 나도 모르게 퇴화 중”

문제는 AI를 어떻게 사용하느냐에 따라 인지 능력의 격차가 더 커질 수 있다는 데 있다. 토론토대 연구팀은 컴퓨터 코딩 문제를 해결하는 학생들의 AI 사용 방식을 분석한 결과, 지식이 충분한 학생은 AI를 적극적으로 활용해 성과를 높인 반면, 경험이 부족한 학생은 AI에 이끌려 비효율적인 경로로 빠지고 성과도 낮았다고 밝혔다.

비슷한 맥락에서, 생성형 AI는 지식이 부족한 사용자일수록 생산성의 도약보다 의존의 함정에 빠질 가능성이 크다. 메타인지 전략이 부족한 상태에서 AI를 과하게 신뢰하면, 사고 능력이 점차 약화되는 현상이 실제로 나타난 것이다.

생성형 AI가 만든 ‘창의력의 착시’

AI는 분명 창의적인 결과물을 빠르게 생성한다. 문제는 그 ‘창의성’이 생각보다 다양하지 않다는 점이다. 덴마크 오르후스대학의 연구에 따르면, 디자이너들이 AI의 결과물에 익숙해지면서 핵심 문제에 대한 탐색은 줄어들고, 오히려 이미 생성된 결과를 미세 조정하는 데만 몰두하는 현상이 생긴다. 이를 ‘디자인 고착(Fixation)’이라고 부른다.

더불어, 글로벌 실험들은 생성형 AI가 창작자의 문체와 아이디어를 서구 중심으로 동질화시키는 경향이 있음을 보여준다. 창의성은 유지되지만, 아이디어의 다양성은 급격히 줄어들고 있다.

AI, 누군가에겐 ‘비서’지만 누군가에겐 ‘사고 방해꾼’

흥미로운 점은 또 있다. MIT와 하버드, BCG 등이 진행한 생산성 실험에서는 AI가 지식노동자의 품질과 속도를 개선했으며, 특히 능력 하위권의 개선 폭이 더 크다는 결과도 나왔다. 하지만 이는 AI가 잘 작동하는 영역(예: 초안 작성, 요약 등)에서만 유효했고, 분석이나 평가처럼 AI의 한계가 뚜렷한 업무에서는 오히려 오류가 증가했다.

즉, AI는 ‘어떤 업무에, 어떤 조건에서 쓰느냐’에 따라 천사일 수도, 악마일 수도 있는 셈이다.

“AI는 똑똑한 척하지 말고, 모르는 척해라”

최근 인지과학자들이 제시한 새로운 방향은 흥미롭다. 바로 ‘무지한 공동 학습자(ignorant co-learner)’라는 개념이다. 이는 AI가 모든 걸 아는 존재가 아니라, 오히려 질문을 던지고 상반된 관점을 제시하며 사용자의 사고를 자극하는 존재로 설계돼야 한다는 주장이다.

이런 형태의 AI는 사용자가 의문을 품고, 다른 해석을 시도하며, 스스로 결론을 도출하게 만든다. 단순한 정보 제공자를 넘어서 사고를 자극하는 ‘코치형 AI’로 진화하는 것이다.

‘챗GPT 바보론’이 맞는 말일 수도 있다, 단 조건이 있다

결론은 단순하다. 챗GPT가 우리를 바보로 만드는 게 아니라, 생각 없이 챗GPT를 쓰는 우리가 스스로를 바보로 만든다는 것이다. 반대로, AI의 한계를 이해하고 비판적으로 활용한다면, AI는 ‘생산성 도구’를 넘어 사고의 촉진제로 진화할 수 있다.

우리는 지금, 도구의 진화보다 더 중요한, 사용자의 진화를 고민해야 할 때다.

신주백 기자 jbshin@kmjournal.net

![[동학] 카카오톡 친구탭, 결국 12월 롤백… “격자형 피드는 선택 옵션으로”](https://cdn.kmjournal.net/news/thumbnail/custom/20251126/5517_10550_1119_1763853080_120.jpg)

![[테크 칼럼] 제미나이3, GPT-5.1을 넘다…AI는 이제 ‘일을 대신하는 시대’로 간다](https://cdn.kmjournal.net/news/thumbnail/custom/20251126/5457_10454_4847_1763621329_120.jpg)