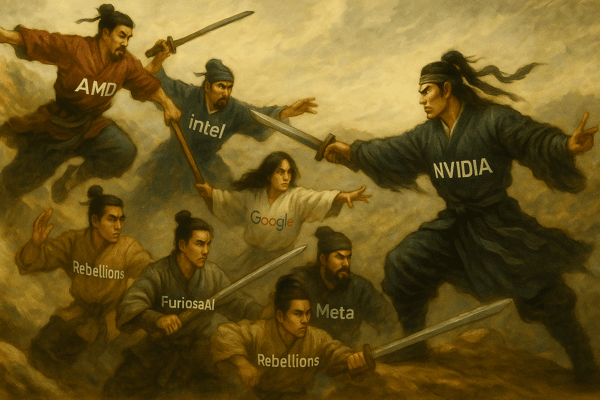

AI 연산의 표준을 독점해온 엔비디아(NVIDIA)가 흔들리고 있다.

차세대 GPU ‘블랙웰(Blackwell)’ 양산을 시작하며 막강한 성능을 과시하고 있지만, AMD와 인텔을 비롯한 글로벌 반도체 기업, 그리고 AWS·구글·메타 같은 클라우드 빅테크들이 GPU의 지배에서 벗어나기 위한 전면적 반격에 나섰다.

국내에서도 리벨리온(Rebellions)과 퓨리오사AI(FuriosaAI) 등 신생 기업들이 ‘소형·고효율·자립형’ 칩을 앞세워 엔비디아 중심의 생태계에 균열을 내고 있다.

CUDA 제국의 시대, 균열이 시작됐다

엔비디아의 생태계는 독자 플랫폼 ‘CUDA’를 중심으로 완벽하게 통제돼 있다.

AI 모델을 개발하려면 대부분의 연구자들이 CUDA 기반 툴을 사용할 수밖에 없었고, 그 결과 엔비디아 GPU는 사실상 AI 연산의 ‘기축 통화’가 됐다.

하지만 최근 몇 년간 “탈(脫) CUDA” 흐름이 전 세계적으로 확산되면서, 균열이 가시화되고 있다.

AMD는 MI300X 시리즈를 앞세워 오픈소스 병렬연산 프레임워크 ‘ROCm’을 전면 개방했다. 오픈AI·메타·마이크로소프트 등 주요 AI 기업들이 테스트에 참여하면서 ‘CUDA 독점’ 구조를 흔드는 첫 균열이 생겼다.

인텔은 GPU 대신 NPU(신경망 처리 장치) 구조를 택한 ‘가우디(Gaudi)’ 시리즈와 함께, 하드웨어 종류에 구애받지 않는 통합 프로그래밍 언어 ‘oneAPI’를 앞세워 생태계 확장에 나섰다.

이처럼 여러 축에서 ‘하드웨어 독점 → 생태계 다원화’로의 전환이 본격화되고 있다.

클라우드 3대 기업, GPU 굴레에서 벗어나다

하드웨어 기업들의 경쟁이 기술적 전환이라면, 클라우드 기업들의 움직임은 산업 질서의 재편이다.

AWS는 자체 설계한 AI 칩 ‘트레이니엄(Trainium) 2’와 ‘인퍼런시아(Inferentia) 3’를 투입해 내부 AI 워크로드의 70% 이상을 GPU 없이 처리하기 시작했다.

구글은 TPU v5를 통해 초거대 언어모델(LLM)의 학습을 전면 자사 인프라에서 수행 중이며, 메타는 자체 설계 가속기 ‘MTIA(Meta Training and Inference Accelerator)’를 활용해 라마(Llama) 학습 효율을 대폭 끌어올렸다.

이들의 목표는 단 하나, GPU의 납기·가격·공급 제약에서 벗어나는 것이다.

칩을 직접 설계·생산함으로써 AI 서비스 확장 속도를 외부 공급망이 아닌 ‘자체 리듬’으로 조정하려는 것이다.

GPU 의존도가 높을수록 비용과 일정은 엔비디아의 손에 달려 있었기 때문이다.

국내 스타트업, ‘작고 강한’ AI칩으로 맞선다

국내에서도 ‘포스트 엔비디아’ 시대를 준비하는 움직임이 활발하다.

리벨리온(Rebellions)은 한국 AI 반도체 시장의 핵심 축으로 자리 잡았다.

사피온코리아와의 통합 이후 하나의 법인으로 정비된 리벨리온은, 차세대 NPU(Neural Processing Unit) 개발을 중심으로 글로벌 시장 진출에 속도를 내고 있다.

회사는 기존 ‘아톰(ATOM)’과 ‘아이온(ION)’ 시리즈에서 검증된 전력 효율성과 경량화 설계를 바탕으로, 엣지·서버·데이터센터를 아우르는 통합 AI 반도체 플랫폼을 추진 중이다.

특히 삼성전자 4나노 공정을 기반으로 한 차세대 칩 개발 프로젝트를 진행하며, SK텔레콤·SK하이닉스 등 주요 투자사와 협력해 상용화 단계를 확대하고 있다.

퓨리오사AI(FuriosaAI)는 추론(인퍼런스)에 특화된 칩 ‘워보이(Warboy)’에 이어, 학습과 추론을 모두 지원하는 차세대 칩 ‘레니게이드(Renegade)’를 공개했다.

회사 측은 “작은 배치 크기의 요청에서도 저지연(Latency)과 낮은 전력 소비를 유지할 수 있도록 설계됐다”고 설명했으며, 실제 테스트 환경에서 엔비디아 GPU 대비 80% 수준의 성능을 절반 이하의 전력으로 구현했다는 결과도 나왔다.

이들 국내 기업들의 공통된 전략은 “국산 칩이 당장 엔비디아 H100을 따라잡겠다”가 아니라, “전력·인프라 제약이 있는 환경에서도 충분히 작동하는 자립형 AI 시스템을 구축하겠다.”는 것이다.

하드웨어 자립만으론 부족하다… ‘K-컴퓨트 스택’의 필요성

정부 역시 AI 반도체 자립을 국가 전략으로 설정했다. 예컨대 과학기술정보통신부는 ‘AI 반도체 고도화 2단계’ 사업을 통해 학습·추론용 국산 칩 실증을 추진 중이다. 또한 국가 AI 팩토리 프로젝트 내에 국산 가속기 테스트베드를 포함시키는 방안이 검토되고 있다는 보도도 있다.

다만 전문가들은 “칩이 뛰어나도 그 위에서 작동할 소프트웨어 생태계가 없다면 자립을 완성할 수 없다”고 지적한다. 아직도 많은 AI 개발 환경은 CUDA 중심으로 돌아가고 있으며, 이는 국산 하드웨어가 외부 표준 위에 계속 종속될 위험을 남긴다.

결국 국산 하드웨어 위에서 작동할 수 있는 오픈소스 연산 프레임워크, 즉 ‘K-컴퓨트 스택’의 구축이 병행돼야 한다. 그래야만 국산 칩이 외부 표준 위에 서지 않고, 한국형 AI 생태계의 독립성을 확보할 수 있다.

엔비디아의 왕좌는 아직 견고하지만, 판은 이미 흔들리고 있다

엔비디아는 여전히 AI 칩 시장의 ‘기축 통화’로 군림하고 있다. 하지만 AMD, 인텔, 클라우드 3대 기업, 그리고 한국의 신생 반도체 스타트업들이 서로 다른 방향에서 균열을 만들어가고 있다.

연산의 표준은 더 이상 단일하지 않다. 트리톤(Triton), ROCm, oneAPI, XLA 같은 오픈 프레임워크들이 CUDA의 자리를 위협하고 있으며, 각국 정부는 AI 반도체 자립을 국가 전략으로 삼고 있다.

엔비디아의 제국은 아직 무너지지 않았지만, ‘GPU 중심 질서’는 이미 해체 과정에 들어섰다.

테크풍운아 칼럼니스트 scienceazac@naver.com

![[동학] 카카오톡 친구탭, 결국 12월 롤백… “격자형 피드는 선택 옵션으로”](https://cdn.kmjournal.net/news/thumbnail/custom/20251126/5517_10550_1119_1763853080_120.jpg)

![[테크 칼럼] 제미나이3, GPT-5.1을 넘다…AI는 이제 ‘일을 대신하는 시대’로 간다](https://cdn.kmjournal.net/news/thumbnail/custom/20251126/5457_10454_4847_1763621329_120.jpg)

![[낭만 테크 시대] AI 대항해 시대](https://cdn.kmjournal.net/news/thumbnail/custom/20251126/5603_10714_4334_1764121414_160.jpg)