140억 매개변수로 6710억 파라미터 AI를 이겼다. 마이크로소프트(MS)가 새롭게 공개한 AI 모델 'rStar2-Agent'가 글로벌 AI 경쟁 구도를 다시 흔들고 있다. 성능과 효율을 동시에 잡은 이 ‘가성비 AI’는 중국 딥시크 이후 흔들린 미국 빅테크의 반격 신호탄이 될 전망이다.

MS, 50분의 1 크기로 딥시크 능가…“더 똑똑하게 생각하는 AI”

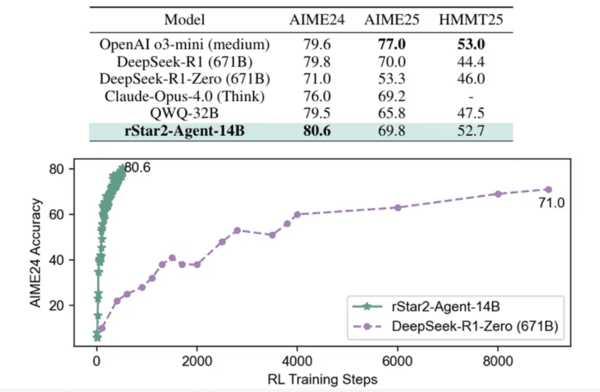

MS가 지난달 말 공개한 AI 모델 'rStar2-Agent'는 매개변수 140억 개 규모에 불과하다. 이는 중국발 초대형 모델 ‘딥시크 R1’의 6710억 개 파라미터에 비해 50분의 1 수준이다. 그러나 성능은 더 높았다. AI 수학능력 평가 지표인 2024 AIME 시험에서 rStar2는 80.6%의 정확도를 기록, 딥시크 R1(79.8%)과 오픈AI o3 미니(79.6%)를 모두 제쳤다.

해당 모델은 단 64개의 AMD GPU, 1주일 훈련만으로도 이 성능을 달성했다. 이는 AI 모델의 크기와 자원 투입이 반드시 성능을 좌우하지는 않음을 보여준다.

AI 학습 방식의 전환…도구 활용 능력으로 추론 성능 극대화

MS는 기존 AI와 전혀 다른 학습 방식을 적용했다. rStar2는 파이썬 코드 4만5000개를 병렬 실행할 수 있는 환경을 구축해, 마치 계산기를 들고 문제를 푸는 학생처럼 효율적으로 학습했다.

이 모델은 연산을 직접 수행하는 대신, 파이썬이라는 외부 도구를 적극 활용하며 문제 해결에 접근했다. MS는 이를 두고 “길게 생각하는 모델이 아닌, 더 똑똑하게 생각하는 모델로의 전환”이라고 평가했다. 실제로 모델은 총 510회의 훈련 스텝만으로 고성능 추론력을 갖추었다.

구글·오픈AI도 경량화 전략 가속…‘나노 모델’ 전쟁 본격화

MS뿐 아니라 주요 빅테크 기업들도 ‘작고 똑똑한 AI’를 앞다투어 개발 중이다. 구글은 지난 7월 Gemini 2.5 Flash-Light 모델을 출시하며, 100만 토큰당 0.1달러라는 낮은 가격과 높은 효율을 강조했다.

오픈AI는 올해 4월 GPT-4.1 발표와 함께 Nano 버전을 공개했다. 이 모델은 경량·고속 추론이 가능해 스마트폰, 태블릿 등 단말기 내 AI 구현도 가능하게 한다.

‘미니’를 넘어 ‘나노’로 확장된 추론 AI 시장은 이제 단순한 크기 싸움이 아니라, 성능-속도-비용의 균형이라는 새로운 척도를 중심으로 재편되고 있다.

신주백 기자 jbshin@kmjournal.net

![[동학] 카카오톡 친구탭, 결국 12월 롤백… “격자형 피드는 선택 옵션으로”](https://cdn.kmjournal.net/news/thumbnail/custom/20251126/5517_10550_1119_1763853080_120.jpg)

![[테크 칼럼] 제미나이3, GPT-5.1을 넘다…AI는 이제 ‘일을 대신하는 시대’로 간다](https://cdn.kmjournal.net/news/thumbnail/custom/20251126/5457_10454_4847_1763621329_120.jpg)

![[낭만 테크 시대] AI 대항해 시대](https://cdn.kmjournal.net/news/thumbnail/custom/20251126/5603_10714_4334_1764121414_160.jpg)